¶ Multi-Layer Perceptron

Ein Multi-Layer Perceptron ist ein neuronales Netz.[1]

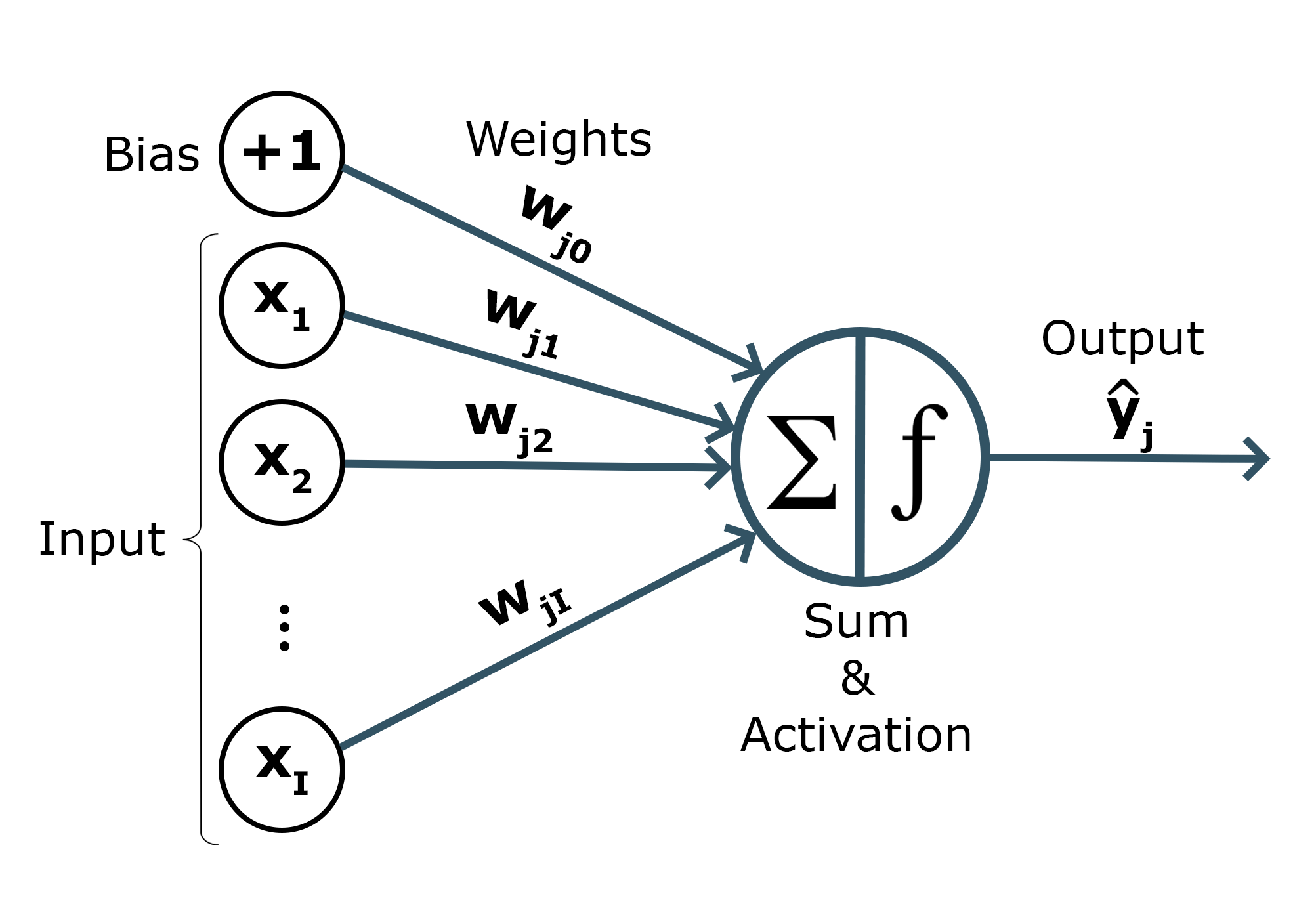

¶ Einzelnes Perzeptron

Ein einzelnes Perzeptron besteht aus einem Neuron , das von -vielen Quellen jeweils einen Input zugeschickt bekommt. Jedes Input ist mit einem individuellem Weight gewichtet und das Neuron summiert zuallererst alle gewichteten Inputs auf. Die Summe wird anschließend an eine Aktivierungsfunktion übergeben und der entsprechende Funktionswert wird vom Neuron als Output weitergeleitet. Konkret sieht die Ausgabe wie folgt aus:

Dabei stellt ein sogenanntes Bias-Signal dar, das ebenfalls mit einem Weight gewichtet ist. Abb. 1 zeigt eine bildhafte Darstellung eines Perzeptrons.

Es gibt diverse Aktivierungsfunktionen, die innerhalb eines Perzeptrons eingesetzt werden können. Beispielsweise kann die Funktion linear sein, d.h. für ein . Auch wird die Heaviside-Funktion häufig für die Aktivierung verwendet. Besonders werden allerdings Sigmoid-Funktionen genutzt, da diese sowohl lineares als auch nicht-lineares Verhalten darstellen können.[1:1] Beispiele sind u.a.:

- die logistische Funktion

- der Tangens hyperbolicus

Ebenfalls beliebt ist der Rectified Linear Unit (ReLU) .

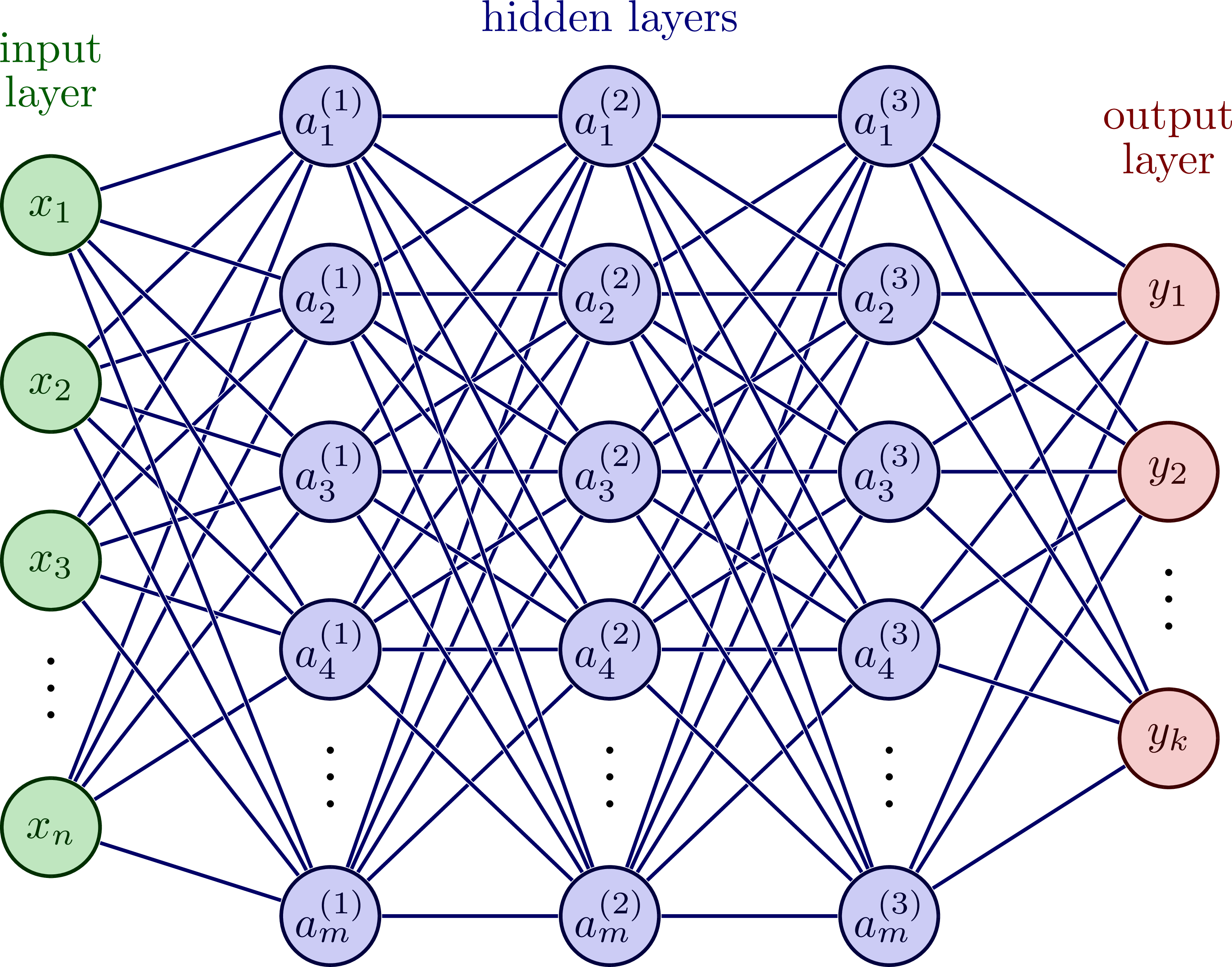

¶ Aufbau

Verkettet man nun mehrere Perzeptronen hintereinander, so hat man ein Multi-Layer Perceptron, das aus mindestens drei Schichten besteht:

- 1 Input-Schicht, wobei die Neuronen dieser Schicht keine Aktivierungsfunktionen haben und den Input lediglich an nachfolgende Neuronen weitergeben

- 1 Output-Schicht

- mindestens 1 verdeckte Schicht zwischen Input- und Output-Schicht

Üblicherweise ist jedes Neuron mit allen anderen aus der nachfolgenden Schicht verbunden; mit Neuronen aus derselben Schicht jedoch nicht (siehe Abb. 2).

¶ Referenzen

¶ Bildquellen

Abb. 1: In Anlehnung an Sidharth. (2023, 11. März). Multi-Layer Perceptron Explained: A Beginner's Guide. https://www.pycodemates.com/2023/01/multi-layer-perceptron-a-complete-overview.html (Abgerufen am 17.01.2024) und Minku, L., Cabral, G. G., Martins, M., & Wagner, M. (2023). Introduction to Computational Intelligence: An IEEE Computational Intelligence Society Open Book. pdf

Abb. 2: Neutelings, I. (o.D.). Neural networks. https://tikz.net/neural_networks/ (Abgerufen am 17.01.2024)